Por JOSE LUIS BOLZAN DE MORAIS & GIANCARLO MONTAGNER COPELLI*

Se o poder invisível dos algoritmos substitui a vontade pessoal do soberano, a democracia definha na opacidade de um neopatrimonialismo técnico, mais concentrado e menos sujeito ao escrutínio público

1.

Comecemos pelos clássicos…

Max Weber, ao distinguir formas de dominação, identificou o patrimonialismo como aquela em que o poder político é apropriado privadamente pelo governante e seus afilhados, responsáveis, a seu turno, pela perenização do poder junto à liderança. A burocracia moderna – embora também rapidamente deteriorada – teria emergido como antídoto a essa lógica, baseada na impessoalidade, na legalidade e na previsibilidade.

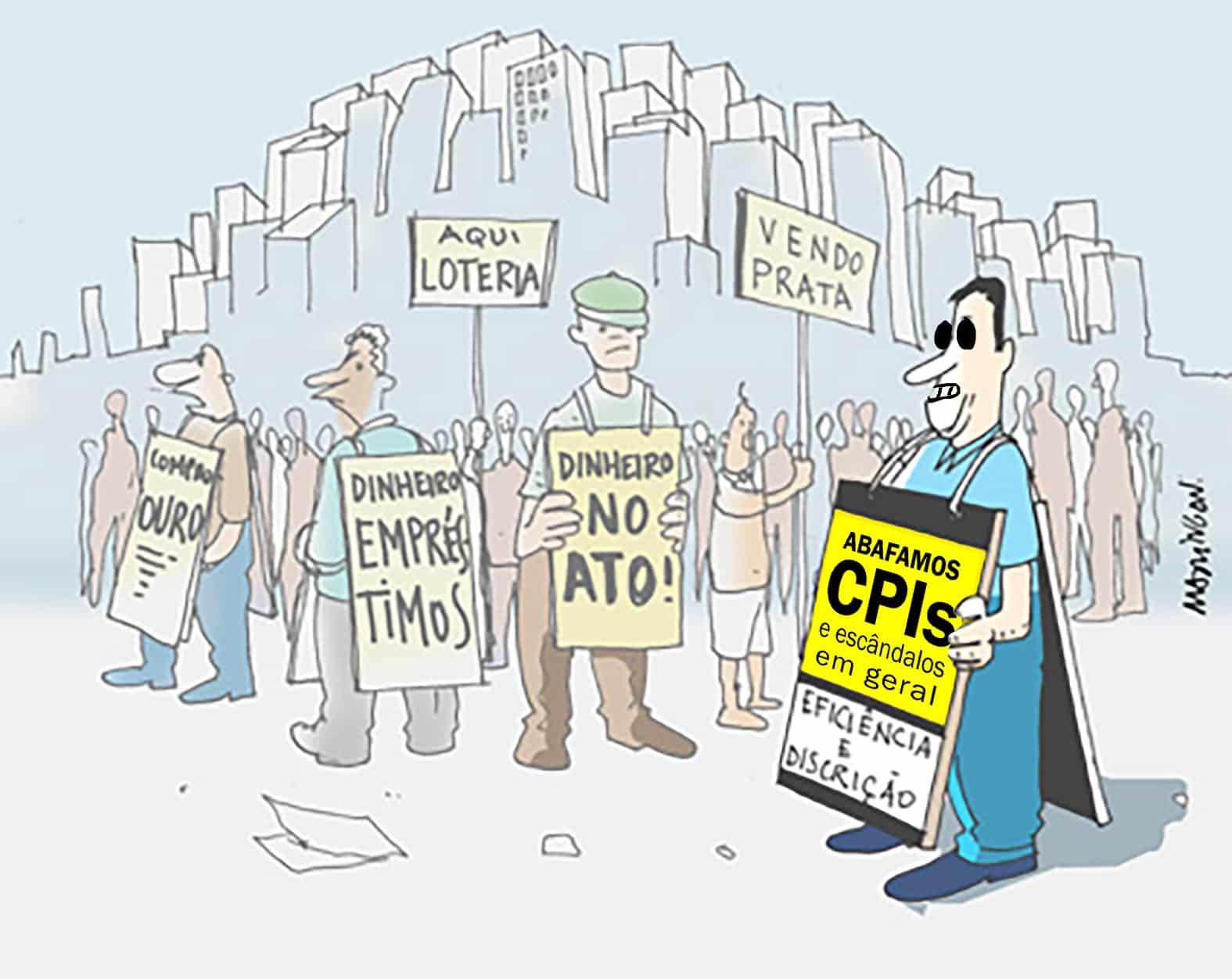

Contudo, como procuraremos argumentar nesse sucinto ensaio, o surgimento do Estado algoritimizado – aquele que governa por meio de sistemas automatizados e opacos – parece (re)introduzir o patrimonialismo sob uma nova perspectiva, ainda mais vertical. Nessa distinção, sob a aparência da eficiência técnica, ele passa a operar uma espécie de concentração radical de poder, mais aguda que no patrimonialismo clássico.

Em linhas gerais, no patrimonialismo tradicional, um reduzido número de servidores – para não pulverizar o poder – obedece diretamente à vontade pessoal do chefe político. Já no modelo algoritimizado, a discricionariedade se torna ainda mais concentrada: algoritmos substituem agentes humanos e operam segundo parâmetros definidos por um número exíguo de técnicos, muitas vezes em nome – mas fora – da esfera pública.

Evidentemente, esses sistemas são fiéis à lógica que os programou, mas não estão sujeitos – como seria oportuno em democracias – à deliberação, revisão ou contestação pública. Como aponta Antoinette Rouvroy, essa “governamentalidade algorítmica” representa um poder sem sujeito, projetando um dos grandes – ou talvez o maior – problema da Teoria de Estado no século XXI”.

Faz sentido. Afinal, como se depreende pelo que até aqui foi exposto, esse já visível contexto das democracias contemporâneas confronta-se com a conhecida perspectiva de Norberto Bobbio, em que a democracia se define, entre outros atributos, pela visibilidade do poder. Queremos dizer, no Estado algoritimizado esse ideal parece ainda mais subvertido no famoso “catálogo de promessas não cumpridas”: decisões são tomadas por sistemas fechados e protegidos pela especialidade técnica em níveis jamais vistos.

Como demonstram Pasquale e Eubanks, os algoritmos de políticas públicas – como os que decidem quem é considerado de alto risco, por exemplo – operam na ambígua lógica da presença e do silêncio: o poder age – porque seu lugar nunca é um lugar vazio, já dizia Lefort –, mas não se mostra. Mais que isso, afeta instantaneamente, mas demora a responder – quando responde.[i]

2.

Assim, como parece ser a lógica já presente no século XXI, o acesso ao poder passa a ser determinado por proximidade com os centros de programação, as big techs – em diálogo cada vez mais próximo com a estatalidade. O Estado torna-se usuário de ferramentas privadas, não mais autor de sua própria ação. Estamos diante de um neopatrimonialismo cibernético?

Intuímos que sim. E nesse modelo, o soberano ou chefe político – mesmo um representante democraticamente eleito – concentra poderes não a partir de um grupo de apadrinhados que age em seu nome – como seria típico da burocracia deteriorada como conhecemos – mais a partir de um pequeno grupo de engenheiros e gestores com acesso privilegiado ao código que governa.

Esse é o argumento alinhado a uma série de efeitos colaterais, por assim dizer, da lógica algorítmica. Contudo, o que pretendemos destacar é ainda mais danoso: o Leviathan sou essa roupagem realiza, com eficácia silenciosa, os desejos mais profundos da prática patrimonialista.

Ao controlar muitos com poucos, reúne sensível vantagem para perpetuar-se no poder. Mais que isso, ao projetar-se ainda mais concentrador que o Estado tradicional, sua legitimidade não advém da tradição (o que já seria problemático), mas da autoridade técnica não sujeita ao debate público.

Esse é o ponto. Muito por isso, retomar o ideal bobbiano de publicidade e o modelo weberiano de controle institucional passa, hoje, pela urgente regulamentação pública dos algoritmos que decidem em nome do Estado. Sem isso, o Estado não apenas se distanciará da democracia, mas fará do projeto inacabado um projeto impossível.

Claro: se a democracia pode ser sintetizada pela horizontalização do poder, partilhando-o, o algoritmo verticaliza o poder, concentrando-o. E aí já não temos democracia. Como lidaremos, no futuro, com essas questões todas?

*José Luis Bolzan de Morais é professor da Faculdade de Direito de Vitória (FDV).

*Giancarlo Montagner Copelli é doutor em Direito Público pela Universidade do Vale do Rio dos Sinos (Unisinos).

Referências

BOBBIO, Norberto. Liberalismo e Democracia. São Paulo: Paz e Terra, 2000.

DONEDA, Danilo; ALMEIDA, Virgílio; BRUNO, Fernanda. O que é a governança de algoritmos. Tecnopolíticas da vigilância: Perspectivas da margem, p. 141-148, 2018.

LEFORT, Claude. Pensando o político. Ensaios sobre democracia, revolução e liberdade. Rio de Janeiro: Paz e Terra, 1991.

PASQUALE, Frank. A esfera pública automatizada. Líbero, n. 39, p. 16-35, 2017.

ROUVROY, Antoinette. Entrevista com Antoinette Rouvroy: governamentalidade algorítmica e a morte da política. Revista de Filosofia moderna e contemporânea, v. 8, n. 3, p. 15-28, 2020.

WEBER, Max. Economia e sociedade. São Paulo: Atlas, 1999.

ZUBOFF, Shoshana. (2020). A Era do Capitalismo de Vigilância. Intrínseca, 2020.

UOL (13/04/2025). Reconhecimento facial de SP confunde idoso com estuprador foragido. Disponível em: https://noticias.uol.com.br/cotidiano/ultimas-noticias/2025/04/13/reconhecimento-facial-de-sp-confunde-idoso-com-estuprador-foragido.htm.

JORNAL DE BRASÍLIA (29/07/2025). Reconhecimento facial é pouco eficaz e viola privacidade, diz estudo. Disponível em: https://jornaldebrasilia.com.br/noticias/brasil/estudo-aponta-riscos-de-tecnologias-de-reconhecimento-facial/

Nota

[i] No Brasil, essa lógica já está em curso. O programa Smart Sampa, da prefeitura de São Paulo, integra mais de 25 mil câmeras com reconhecimento facial, localizando foragidos com algoritmos cuja operação permanece opaca. Segundo levantamento da Defensoria Pública da União e do CESeC, ao menos 376 projetos de vigilância facial estão em operação, cobrindo cerca de 83 milhões de pessoas. Casos de erro são recorrentes: um idoso foi preso por engano por 26 dias após o sistema confundi-lo com um estuprador foragido (UOL, 13/04/2025).

A Terra é Redonda existe graças aos nossos leitores e apoiadores.

Ajude-nos a manter esta ideia.

CONTRIBUA