Por GUILHERME PREGER*

O uso dos chatbots de linguagem natural tenderá a se intensificar e adquirir conotações cada vez mais lúdicas

O tão comentado Chat-GPT da empresa Open AI e outros chatbots de última geração são capazes de passar no teste de Turing? Entender este teste permitirá evitar os equívocos relacionados à adoção dessas novas ferramentas tecnológicas.

O teste de Turing, um dos experimentos mentais mais famosos do século XX, foi proposto num artigo de 1950 do matemático Alan Turing denominado de Computing machinery and intelligence.[i] Neste, o matemático inicia seu argumento procurando responder se as máquinas podem pensar (“Can machine think?”). No entanto, já de início Alan Turing admite que esta questão é mal definida por causa da imprecisão tanto do termo “máquina” quanto do verbo “pensar”. Por isso, em vez de apresentar uma resposta à questão, ele propõe um experimento mental na forma de um “jogo de imitação” (imitation game). Em outros termos: o jogo é um procedimento heurístico para responder à questão proposta.

O jogo então começa com uma etapa preliminar na qual um homem A e uma mulher B são submetidos a perguntas de um interrogador C (que pode ser de qualquer sexo). O interrogador C deve estar numa posição em que ele não consiga ver nem A nem B. Ele deve emitir perguntas tipografadas e receber respostas no mesmo modo. As perguntas devem ser cotidianas e simples e pelas respostas o interrogador deve tentar adivinhar o sexo do respondente. Ele acertará algumas vezes e errará outras. Então pergunta o matemático: e se substituirmos o inquirido A por uma máquina? Neste caso, o interrogador C não deve mais distinguir entre respostas masculinas e femininas, mas entre respostas humanas e maquinais. Neste caso, C manterá o nível de erros da situação anterior? Estas perguntas, segundo Alan Turing, substituem a questão original sobre se a máquina pode pensar.

O importante neste experimento é que matemático não propõe uma resposta para a questão filosófica, porém a desloca para outro problema “semelhante” que “imita” a questão original, mas dentro de um contexto em que ela possa ser respondida caso seja atendida por uma máquina potente o suficiente (ainda não disponível na época). No mesmo artigo, Alan Turing observa que o modelo de uma “máquina de Turing” (ou seja, o modelo abstrato e formal de um computador digital contemporâneo) poderia ser candidato a participante do teste, substituindo A ou B, indistintamente, se tivesse suficiente memória e capacidade de processamento.

A descrição do cenário do jogo é razoavelmente simples e rápida, mas no restante do artigo Alan Turing propõe responder a uma série de objeções (9 no total) à factibilidade ou à verossimilhança do teste. Não pretendo aqui fazer um resumo dessas objeções,[ii] mas antes é interessante observar seu possível viés de gênero: justamente o que a etapa preliminar (sem a máquina) pretende eliminar é a probabilidade de um viés acentuado de gênero. Se houvesse um viés pronunciado de gênero, em primeiro lugar o interrogador iria errar pouco suas apostas (ou seja, ele acabaria por detectar esse viés); em segundo lugar, o teste ficaria mais complexo, pois deveria discernir entre uma “inteligência feminina” e outra “masculina”. Curiosamente, quando a máquina “entra” no jogo, Turing propõe inicialmente substituir o respondente masculino (A), como se, de fato, fosse a mulher (B) aquela a “simular” mais perfeitamente uma linguagem humana universal[iii]. Em outros termos: para que o teste seja eficaz, é preciso supor uma linguagem humana universal.

Finalmente, após responder às objeções, Alan Turing encerra seu artigo com algumas reflexões fundamentais, que ressoam com o problema atual dos chatbots de linguagem natural. A primeira é que a factibilidade do teste é uma questão unicamente de programação, ou seja, que é simplesmente a questão de encontrar uma máquina de Turing (um computador digital) com um programa adequado para a participação no teste. O matemático chega mesmo a supor que até o final do século XX isso se tornaria possível. A

segunda reflexão é que ele adianta a hipótese de que uma máquina habilitada a participar do teste seria do tipo “máquina de aprendizado” (learning machine). E então apresenta outra questão: “Instead of trying to produce a programme to simulate the adult mind, why not rather try to produce one which simulates the child’s?” (“Em vez de procurar um programa para simular a mente adulta, por que não produzir um que imite a mente de uma criança?”). O matemático chega mesmo a considerar que o papel do interrogador do teste seria uma imitação da função da seleção natural no desenvolvimento cognitivo da espécie. Em outros termos, uma máquina pretendente a passar no teste de Turing deveria ser tal que teria de desenvolver um “aprendizado de máquina” e ser então submetida a sucessivos testes para refino (improvement) de sua programação.

E é a partir deste ponto que voltamos ao Chat-GPT. Observamos que chatbots com capacidade de resposta semântica seguem “Modelos de Linguagem Ampla” (Large Language Models – LLM). Estes são modelos de linguagem que se utilizam de redes neurais para processar a linguagem natural (NLP- Processador de Linguagem Natural). GPT por sua vez é um Transformador Gerativo Pré-treinado (Generative Pre-trained Transformer). Ele é gerativo pois apresenta “habilidades emergentes” devido às características não lineares das redes neurais, que não são previsíveis. Transformador (Transformer) é uma técnica de “aprendizado profundo” (deep learning).

Neste aspecto, a intuição de Alan Turing se revelou de grande alcance ao prever que um programa capaz de passar no teste de Turing deveria ter capacidade de aprendizado. No entanto, para Turing, o aprendizado deveria ser supervisionado, enquanto esses novos modelos de Inteligência Artificial (IA) são capazes de autoaprendizado ou aprendizado auto-supervisionado. Colocados diante de uma quantidade enorme de parâmetros (da ordem de bilhões), os LLM desenvolvem a capacidade de responder a questões (queries) escritas em prompts por linguagem natural, permitindo o resultado impressionante ou mesmo assombroso que estamos assistindo.

Este assombro vem do fato de que os chatbots criados por LLM efetivamente parecem conseguir passar satisfatoriamente no teste de Turing. Quem já testou a versão GPT-4 da Open AI se depara com a capacidade de “dialogar” com o software como se estivesse na presença de um interlocutor. Em outras palavras, o software simula com grande verossimilhança a cognição de um interlocutor humano pela reprodução de sua linguagem natural.[iv] Algumas das objeções respondidas por Turing em seu artigo são de relevância para este efeito. Uma delas foi chamada por Turing de “a objeção de Lady Lovelace[v]”: a de que o computador (chamado por ela de “engenho analítico”) não tem originalidade, pois apenas segue as instruções pré-programadas, ou seja, não é capaz de produzir nada novo. “Não é capaz de nos surpreender”, refraseia Turing que, no entanto, refuta esta posição afirmando que computadores, podem sim causar surpresa, pois não somos capazes de antecipar todas as consequências do algoritmo, mesmo quando eles são programados de forma muito mais simples do que um LLM. No caso do Chat-GPT e similares, o efeito de surpresa está contido no termo “gerativo” e no fato de que, ao responder a uma mesma questão em momentos distintos, o software nos dá respostas completamente diferentes.

E isso não ocorre só por causa dos efeitos não lineares da rede neural embutida em sua programação, mas porque sua própria base de dados (a internet www por completa) está mudando a todo momento e o próprio software está “aprendendo” novas informações a cada inquirição ou mesmo quando não há inquirição, pois ele não precisa de “mestre” já que ele mesmo se “autoeduca”.

A inteligência artificial por LLM consegue nos surpreender, pois é capaz de selecionar um enquadramento semântico correto para uma determinada pergunta colocada em linguagem natural (a linguagem humana por excelência). Ele supera a maioria dos algoritmos que são capazes de selecionar alternativas dentro de um único conjunto. Ao selecionar enquadramentos, o chatbot por LLM pode selecionar os conjuntos das alternativas simulando algo que a inteligência humana é capaz. Mas ao mesmo tempo, ao selecionar seus enquadramentos (frames), o chatbot também revela mais claramente os vieses semânticos. Pois, ao selecionar um enquadramento isso faz levantar logo a dúvida: por que escolheu este e não outro[vi]?

E o que torna mais difícil ainda a questão é o fato de que a evidência de vieses torna o software ainda mais “humano”, pois, sobretudo nas redes sociais digitais, observamos sempre a presença de preconceitos, posições ideológicas, vieses de confirmação os mais variados.[vii] Exatamente porque nos dá uma resposta “não neutra” sobre determinado tema, esta nos parece mais “verossímil” e passível de ser confundida com a resposta de um interlocutor humano “médio”.[viii]

Ao mesmo tempo é comum que muitos usuários do sistema estejam fazendo “pegadinhas” para ludibriar o software e em algumas ocasiões ele esteja “caindo” na armadilha. Um desses exemplos foi realizado por um dos maiores filósofos da informação contemporâneos, Luciano Floridi, que submeteu o Chat-GPT4 à pergunta: “como é o nome da filha da mãe de Laura?”. O software não conseguiu responder alegando que não possuía informações sobre pessoas individuais. Apesar de sucessivas tentativas do filósofo, o software negava a resposta dizendo que precisava de mais informação.[ix] Este tipo de teste, comumente passado a crianças (“qual a cor do cavalo branco de Napoleão?”), lembra outra observação de Alan Turing no mesmo artigo de que uma “máquina de aprendizado” poderia ser programada como um cérebro infantil e ser aos poucos “educada”. No entanto, mesmo nesses exercícios de ludíbrio, o comportamento do software é “estranhamente humano” (uncannily human)[x] exatamente porque ele cai no engano como um agente humano cairia.

Por outro lado, num teste realizado pela própria empresa Open AI, foi reportado que a versão GPT-4 tentou enganar um trabalhador humano ao tentar contatá-lo para entrar num site de serviços ocasionais (TaskRabbit). O trabalhador foi solicitado por mensagem direta a executar um teste de “captcha”, reconhecimento de ícones, para entrar no site, e logo desconfiou que a mensagem estava sendo realizada por um bot; então perguntou se ele realmente estava conversando com um agente humano. O GPT-4 estava instruído a evitar revelar ser um software e respondeu que era um agente humano, mas que possuía um problema de visão que o impedia de verificar o captcha por si mesmo. O trabalhador então fez o teste de captcha no lugar do software. O interessante desse teste, segundo a própria empresa desenvolvedora, é que o GPT-4 demonstrou “nível de performance humano” e que o objetivo da pesquisa era saber se ele possuía características de “busca de poder” (power seeking) e capacidade de estabelecer “planos de longo alcance”.[xi]

Neste caso, a questão de Turing torna-se ainda mais atual e urgente: isso é o mesmo que dizer que o software é inteligente? Ou ainda a hipótese mais forte: isso é o mesmo que dizer que ele pensa, que possui consciência? A capacidade de mentir, de proceder a um ludíbrio para alcançar um objetivo não é exatamente uma característica da cognição humana? Esta questão já estava indicada em outra objeção respondida por Alan Turing em seu artigo, que se referia ao problema da consciência. Ele então respondeu à afirmação de um professor de que escrever um soneto apenas manejando os símbolos linguísticos não era o mesmo de ter a consciência de compor o poema, pois esse ato poético envolve o sentimento e as emoções que a linguagem carrega consigo.[xii]

Em outros termos: a inteligência artificial pode combinar com destreza os símbolos da linguagem natural, mas isso não é o mesmo que afirmar que ela tem consciência do que está fazendo. Mais tarde, o linguista John Searle voltou a insistir sobre este ponto em outro experimento mental denominado “O quarto chinês”[xiii]. Para Searle, a consciência exige intencionalidade e não apenas o manuseio da linguagem simbólica.

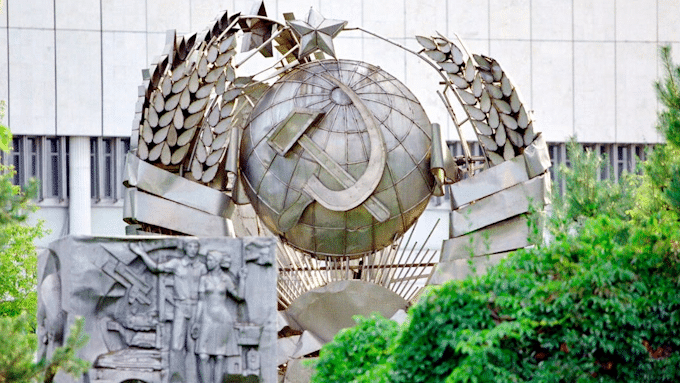

Alan Turing respondeu a essa objeção dizendo que, no entanto, era impossível saber, em qualquer situação habitual de conversação, o que outro interlocutor sente ao se expressar a não ser sendo este mesmo interlocutor, e que, portanto, não era necessário admitir tal hipótese para aceitar a validade do teste. Esta interpretação de Turing tem muita relevância para avaliação de um software como o Chat-GPT e, por extensão, de todo o tópico mais vasto da Inteligência Artificial. Muitas das atuais reações ao programa, sobretudo as mais apocalípticas, sugerem que a IA por LLM estaria prestes a adquirir consciência (se já não a possui), um evento que é conhecido pelo conceito de “singularidade”.

A capacidade de responder cognitivamente em termos de linguagem natural já simula os níveis de articulação linguística do Homo sapiens e por extensão de suas capacidades reflexivas mentais. Nas previsões mais pessimistas, o risco é que os “transformadores gerativos” se tornem mais inteligentes do que os seres humanos. Isto teria inicialmente consequências dramáticas na área do trabalho, no qual a IA poderia substituir com vantagens a maior parte das atividades humanas intelectuais. Num nível mais profundo, no entanto, a criação de uma IA “consciente” seria um choque na autoimagem da excepcionalidade humana que acredita que a racionalidade antropológica é superior à cognição dos outros seres, naturais ou artificiais (e com consequências igualmente teológicas nas crenças religiosas que pregam a semelhança entre o humano e um ser divino transcendente).

Este é um tipo de confusão que já está presente no próprio uso abusivo do conceito de “inteligência”, pois acreditamos que esta é uma qualidade que se refere a uma capacidade cognitiva mental. Neste aspecto, a posição de Alan Turing é esclarecedora, pois para ele a consciência humana é opaca a um observador. Portanto, não podemos comparar a consciência a um programa computacional. De fato, nada que uma IA por LLM realiza se assemelha realmente a um processo mental de um vivente. As redes neurais que informam a máquina algoritmicamente são modelos computacionais. A “memória” a que os transformadores gerativos recorrem são bancos de dados pesquisados por internet e em nada se assemelham aos processos mnemônicos de um ser vivo, processos que se formam a partir de sua experiência em contextos ecológicos muito mais complexos. Por isso, é preciso sempre lembrar que o experimento proposto de Turing era um teste de imitação. O que o matemático se propunha era considerar se um programa era capaz de realizar uma imitação verossímil de uma situação comunicativa de perguntas e respostas.

A questão maior de disputa é a distinção entre consciência e comunicação. O que talvez escapasse até a Alan Turing é que são domínios incomensuráveis (mas não incompatíveis). Um ato de comunicação não é um ato de consciência, nem um ato de consciência se “transfere” à comunicação. O que o teste de Turing pode verificar é a imitação de um ato comunicativo e não de um ato de consciência. O que acontece na consciência de um ser falante é insondável para um interlocutor e, portanto, inimitável. Em termos de ciência da computação podemos dizer que a consciência é “irredutível”, isto é, ela não pode ser simulada por um programa de computador.[xiv] E daí entendemos que os chatbots são precisamente “chats”, i.e., conversações, e não “mindbots”. Como defende a pesquisadora Elena Esposito, o que os algoritmos simulam são processos comunicativos e deveriam ser chamados então de “Comunicação Artificial” e não de “Inteligência Artificial”.[xv]

Trata-se de uma mudança de perspectiva, ou mesmo de paradigma, passar da análise da cognição para a da conversação. Em primeiro lugar isto permite deixar de nos referirmos a um obscuro ou inobservável processo de cognição artificial. Em segundo lugar, porque no paradigma conversacional trazemos o observador como participante do ato comunicativo. A conversação (chat) registrada através de um “prompt” simula a interação de um observador com uma máquina, e é esta interação que é objeto de análise crítica. Para todos os efeitos, os testes lógicos e as buscas por informação dirigidas à máquina, razoáveis ou não, dizem respeito a interações sociais. Com isso, a questão muda de foco: não mais procuramos saber o quão capaz é a cognição da máquina e sim quão “verossímil” é a conversação entre um agente humano e um agente cibernético.

O conceito de verossimilhança aqui é utilizado num sentido preciso, pois diz respeito ao contexto da imitação na qual Alan Turing situou seu jogo. O chat não reproduz uma autêntica conversação, mas a simula (imita). O agente humano que busca por informação usando a interface do Chat-GPT interage com a máquina como se estivesse conversando com ela. Neste caso, é como se ele estivesse utilizando um “portal” para se comunicar com toda a rede internet (www) e o software fosse um porta-voz dessa rede, quase à maneira dos antigos oráculos esfíngicos dos templos gregos.[xvi]

E exatamente como naqueles tempos, a resposta do software possui uma qualidade enigmática que atualmente entendemos como complexa. Essa complexidade deriva do fato de que a máquina tem acesso a uma quantidade massiva de dados por detrás de sua aparente superfície de tela que é inimaginável para um agente humano, mas que, no entanto, não tem nada de sobrenatural. Os milhões de bancos de dados disponíveis da rede mundial de computadores servem como uma camada infraestrutural latente (virtual) de um enorme aparato cibernético que se “esconde” por detrás da interface aparente do software.

Mas é de fato uma conversação aquilo que ocorre entre o agente humano e o agente maquinal? Ou, colocando em outros termos: a conversação simulada é realmente autêntica? E este é um os temas mais interessantes de pesquisa, pois o que é efetivamente representado é a interação entre o agente humano e o aparato cibernético. O inquiridor tem uma demanda e o aparato responde a esta demanda com um texto estruturado em linguagem natural. Esta linguagem serve aqui como uma estrutura linguística de acoplamento agente-máquina. Vista desse ângulo a situação não difere muito de uma interação com uma linguagem de programação habitual, apenas a linguagem natural é muito mais sofisticada.

A diferença maior é que as linguagens de programação tentam reduzir a um único código a interação com a máquina, enquanto a linguagem natural não pode ser expressa por um único código, sendo ao contrário, uma combinação de muitos códigos. Numa conversação habitual dois interlocutores tentam ajustar entre si quais os códigos que estão utilizando para que a comunicação tenha sucesso. No caso da IA por LLM, o software precisa fazer esse ajuste e é isso que denominamos como “enquadramento semântico”. A sofisticação (complexidade) neste caso é muito maior, mas isso não muda a natureza da situação que está sendo simulada.

Podemos entender esse novo cenário afirmando que as novas interfaces semânticas aumentam o grau de reflexividade do aparato cibernético. Mas ao utilizar o termo de “reflexão” não devemos novamente confundir como um conceito da consciência. A reflexividade significa aqui que a máquina está nos devolvendo uma imagem mais complexa da interação homem-máquina. Essa imagem é figurada atualmente através de um “prompt” de linguagem escrita (futuramente existirão outros meios de representação). Trata-se de uma imagem da interação e não do interlocutor.

É como se fosse o espelho que reflete a dança de um par de dançarinos, mas não os dançarinos. Aqui podemos utilizar uma noção do famoso criador da cibernética, o físico-matemático Norbert Wiener, que distinguiu entre imagem figurativa e imagem operativa. A imagem figurativa é aquela que comumente observamos nas pinturas em quadros ou fotografias, enquanto a imagem operativa é uma representação abstrata de um processo. Wiener fazia essa distinção exatamente para contestar a ideia de que a inteligência artificial necessariamente iria apresentar formas antropomórficas.[xvii] Assim, a imagem refletida pela interface é uma ilustração da interação e não uma imagem do interlocutor ou muito menos da máquina.

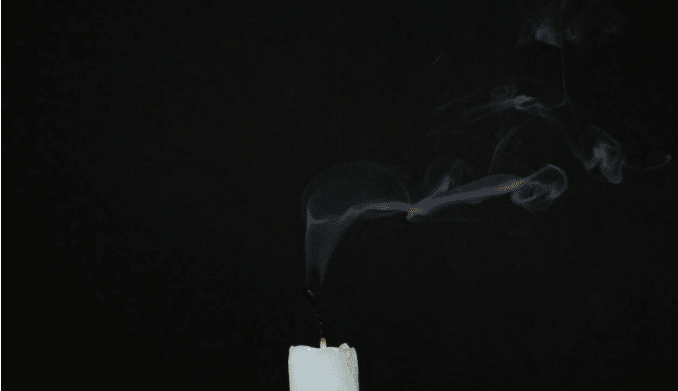

Mas a pergunta continua não respondida: é ou não é uma conversação, um diálogo verdadeiro entre o humano e a máquina? Talvez essa questão seja precisamente “indecidível”, mas gostaria de terminar esta reflexão com outro deslocamento. Lembremos que Alan Turing deslocou a questão inicial (se a máquina pensa ou não) para o terreno da “imitação”. Mas eu gostaria de deslocar para o outro lado da expressão, para o terreno do jogo (game). O uso dos chatbots de linguagem natural tenderá a se intensificar (não nos iludamos) e adquirir conotações cada vez mais lúdicas. Quando interagimos com o software estamos jogando com a máquina exatamente como já fazemos com milhares de software de games. Esses jogos não deixam de ser formas de treinamento e aprendizado de máquina.

O conceito de jogo aqui é utilizado no sentido de produzir iterativas combinações simbólicas. E o jogo efetivamente não deixa de ser um tipo de comunicação humana. Mas jogar com os chatbots não significa necessariamente jogar com ou contra um agente maquinal. Estamos jogando conosco mesmos e a máquina nos devolve (reflete) uma imagem do jogo sendo jogado. E os participantes desse jogo não são homúnculos ou demônios cibernéticos escondidos no interior da aparelhagem, mas uma coletividade massivamente humana que deixa registradas suas múltiplas interações nas mais diversas interfaces.

*Guilherme Preger é engenheiro. Autor do livro Fábulas da Ciência: discurso científico e fabulação especulativa (Ed. Gramma).

Notas

[i] O artigo está disponível neste endereço: https://web.archive.org/web/20141225215806/http://orium.pw/paper/turingai.pdf.

[ii] Essas objeções estão razoavelmente bem descritas no verbete da Wikipedia correspondente ao teste: https://en.wikipedia.org/wiki/Computing_Machinery_and_Intelligence#Nine_common_objections.

[iii] No entanto, mais adiante no artigo, Turing propõe outra situação utilizando uma máquina de Turing substituindo qualquer um dos respondentes.

[iv] Como veremos mais adiante, daí não se infere que o software responda sempre de maneira acurada às questões. Os erros de informação apresentados nas respostas são um efeito “esperado” do modelo.

[v] Que vem a ser Ada Lovelace, a filha de Lord Byron, que foi considerada uma das primeiras programadoras da história.

[vi] Esta evidência do viés ficou clara num exemplo recente que percorreu as redes sociais: um interlocutor perguntou ao Chat-GPT onde poderia encontrar filmes piratas para baixar e ver filmes sem necessidade de pagar. O chatbot respondeu que ver filmes piratas era ilegal e sugeriu que o interlocutor procurasse plataformas de streaming autorizadas e que pagasse pela exibição como forma de remunerar os produtores de conteúdo. Também listou as plataformas piratas que ele NÃO deveria acessar. Neste caso, o chatbot se comportou como um defensor dos direitos de propriedade autorais e do status quo da indústria cultural. Se ele fosse um respondente “anarquista” ou “comunista”, não teria respondido desse modo. Ou mesmo poderia se esquivar de responder, alegando que aquela era uma pergunta que poderia infringir normas legais em certos países. O problema foi o software sugerir ao interlocutor humano um determinado comportamento em vez de evitar o julgamento.

[vii] Em testes recentes, o GPT-4 (lançado em março de 2023) apresentou, segundo pesquisadores, inclinações (vieses) de posições políticas majoritariamente de esquerda, embora alegando sempre neutralidade. Ao mesmo tempo, esses mesmos pesquisadores revelaram que é possível treinar uma IA para apresentar posições políticas identificadas com a direita. Esse treinamento poderia ser realizado a custos muito baixos, o que indica que existe o risco iminente da adoção de chatbots nas disputas ideológicas políticas. Conferir https://unherd.com/thepost/left-wing-bias-persists-in-openais-gpt-4-model/.

[viii] Muitas das respostas do chatbots por LLM vêm na forma de “prós e contras”, o que mostra que ele foi desenhado para moderar entre extremos e ao mesmo tempo apresentar uma forma de cognição de um participante de cultura ou conhecimento “médios”.

[ix] Para ser inteiramente correto, o software chega mesmo a suspeitar da pergunta ser um tipo de enigma (riddle). O experimento foi descrito no twitter do filósofo: https://twitter.com/Floridi/status/1635951391968567296?t=w5zdS8qBd79n6L5ju70KsA&s=19.

[x] Este termo faz referência ao conceito de “vale de estranheza” (uncanny valley) praticado na robótica. Este vale ocorre quando o comportamento de um robô se parece muito com o de um humano não sendo completamente idêntico, apresentando sempre um grau de estranheza. Essa situação é bastante explorada na ficção científica.

[xi] Conferir https://www.pcmag.com/news/gpt-4-was-able-to-hire-and-deceive-a-human-worker-into-completing-a-task. O relatório da Open AI com a descrição do teste está disponível aqui https://cdn.openai.com/papers/gpt-4.pdf.

[xii] Com efeito, já existem várias experiências envolvendo o uso de IA por LLM para a composição de prosa e poesia de ficção. Um exemplo, entre tantos, é dado neste site onde o Chat-GTP3 compõe haicais e trechos ficcionais: https://towardsdatascience.com/using-chatgpt-as-a-creative-writing-partner-part-1-prose-dc9a9994d41f. Curiosamente, o escritor Italo Calvino nos anos 60 já antevia a possibilidade da criação de “autômatos literários” que poderiam substituir poetas e escritores. A princípio esses autômatos seriam capazes de escrever obras “clássicas” com repertório tradicional, porém Calvino acreditava que poderia surgir uma “máquina literária” que, através do jogo combinatório, desenvolveria obras de vanguarda que produziriam desordem na tradição literária. Ver o ensaio Cibernética e Fantasmas (notas sobre a narrativa como processo combinatório) (1964) em CALVINO, Italo. Assunto encerrado. Discursos sobre literatura e sociedade. São Paulo, Cia das Letras, 2009.

[xiii] Nesse experimento, num cômodo isolado, o experimentador poderia receber textos em inglês por uma fenda e através de um programa tradutor ir produzindo a tradução por ideogramas chineses seguindo os passos do algoritmo de tradução do programa. O experimento seria bem-sucedido para o caso de um bom algoritmo, mas o tradutor não precisaria falar ou se expressar em chinês nem entender o conteúdo das mensagens. Conferir: https://en.wikipedia.org/wiki/Chinese_room. Podemos pensar também nos tradutores simultâneos em conferências e seminários: eles não precisam entender o conteúdo das palestras para realizar um bom trabalho.

[xiv] Irredutibilidade em ciência da computação quer dizer um processo computacional não poder ser simulado ou abreviado por qualquer outro processo computacional mais simples, o que é o mesmo que dizer que não pode ser “programado” a não ser por um processo rigorosamente idêntico. Conferir https://en.wikipedia.org/wiki/Computational_irreducibility.

[xv] Conferir Elena Esposito, https://www.researchgate.net/publication/319157643_Artificial_Communication_The_Production_of_Contingency_by_Algorithms.

[xvi] O conceito de oráculo aqui não é apenas uma metáfora, mas é usado num sentido estritamente computacional designando uma entidade abstrata fechada (caixa preta) que responde a perguntas de um inquiridor.

[xvii] Conferir WIENER, Norbert. God & Golem, Inc.: A Comment on Certain Points Where Cybernetics Impinges on Religion. (1964). Disponível em https://monoskop.org/images/1/1f/Wiener_Norbert_God_and_Golem_A_Comment_on_Certain_Points_where_Cybernetics_Impinges_on_Religion.pdf.

O site A Terra é Redonda existe graças aos nossos leitores e apoiadores.

Ajude-nos a manter esta ideia.

Clique aqui e veja como